Każde zadanie potrzebuje własnego modelu

Ten sam workflow w Jira może sprawiać wrażenie precyzyjnego lub dziwnie nierównego, w zależności od tego, który model stoi za każdym krokiem. Liczy się nie to, kto wygrywa benchmarki, lecz dlaczego określeni dostawcy wciąż zdobywają te same role w prawdziwym produkcie.

Dlaczego to nie jest artykuł o benchmarkach

To nie jest ranking. W Just przydatne pytanie nie brzmi, który model wygląda najinteligentniej w abstrakcji. Chodzi o to, który sprawia, że każdy krok workflow jest czystszy, bardziej stabilny i godny zaufania.

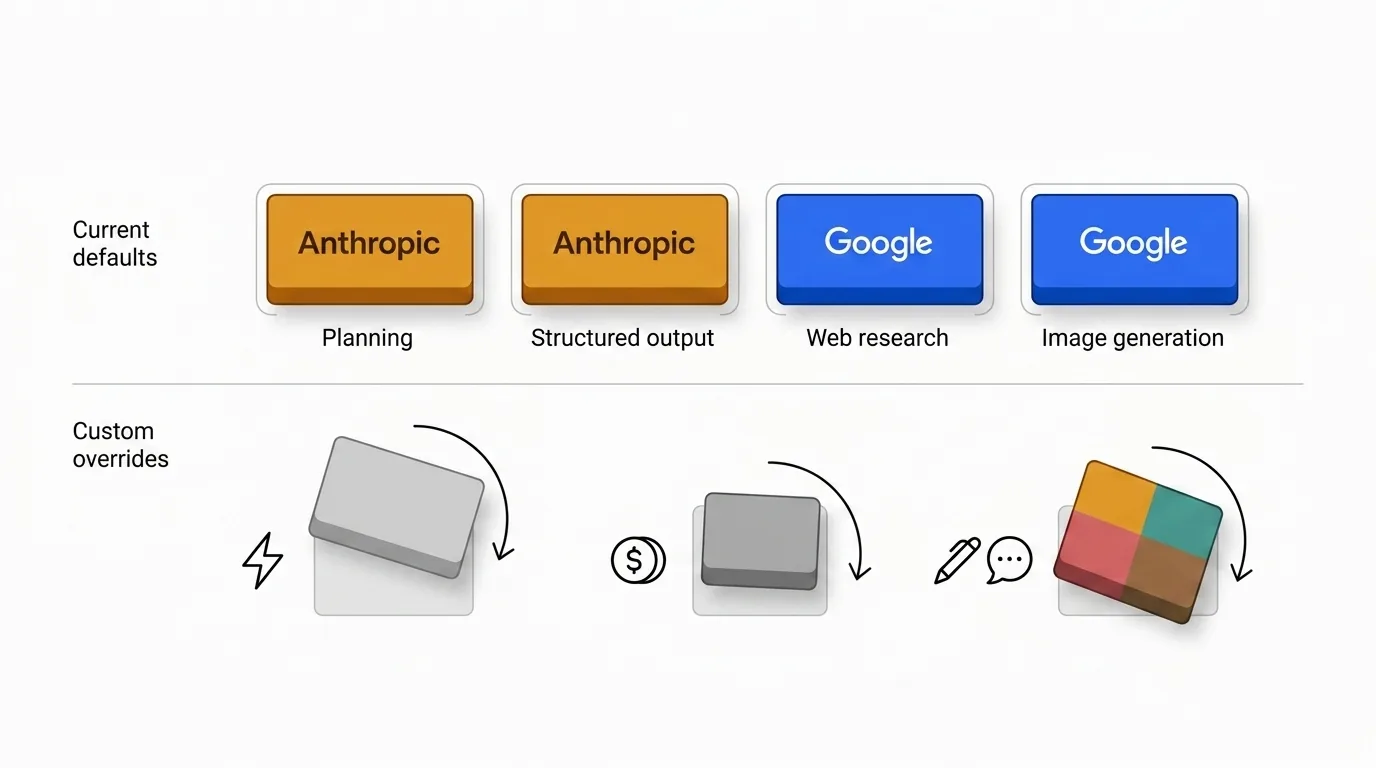

Właśnie dlatego ustawienia domyślne są tu celowo nierówne. Niektórzy dostawcy stale zdobywają rdzeń planowania, podczas gdy inni mają więcej sensu, gdy ważniejsza jest świeżość, jakość wyszukiwania lub wyjście multimodalne.

Jeśli chcesz zobaczyć, jak ta logika wygląda po zintegrowaniu z produktem, Just 2.0: Insights, wyszukiwanie w sieci, obrazy i wspólny kontekst przechodzi przez aktualny workflow w praktyce.

Pełną mapę możliwości przedstawia matryca AI na stronie głównej — widać tam, co każdy dostawca obsługuje w każdej funkcji. Poniższa wersja to krótszy, artykułowy widok.

| Funkcja | |||||

|---|---|---|---|---|---|

| Odpowiedź tekstowa | |||||

| Odpowiedź z rozumowaniem | |||||

| Ustrukturyzowany wynik | |||||

| Generowanie obrazów | |||||

| Wyszukiwanie w sieci |

Dlaczego Anthropic trzyma rdzeń

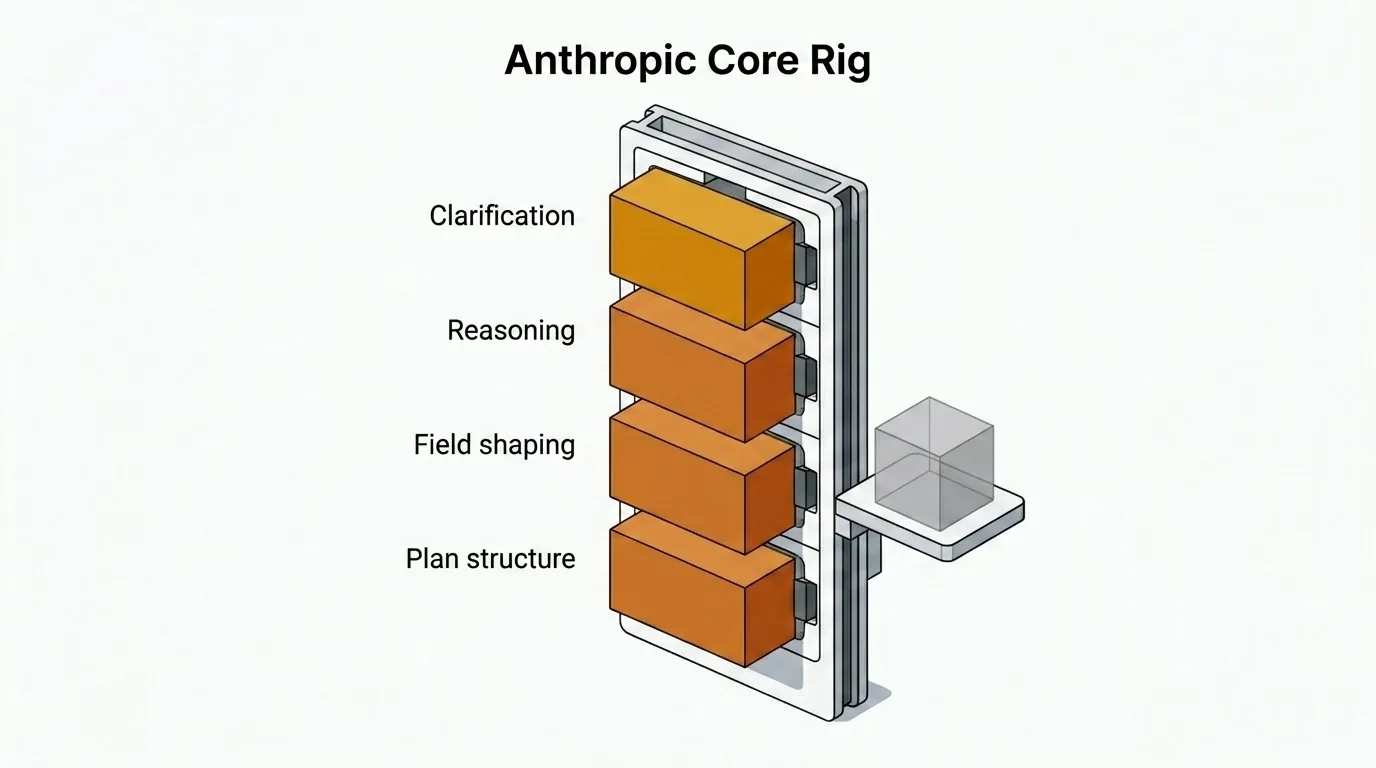

Rdzeń Just — pytania wyjaśniające, ustrukturyzowane plany, kształtowanie pól zadań i odpowiedzi wymagające intensywnego rozumowania — działa domyślnie na Anthropic. To świadomy wybór, który wiąże się z kompromisem, który zaakceptowałem.

| Krok | Model | Jakość | Szybkość | Cena |

|---|---|---|---|---|

| Odpowiedzi tekstowe | Claude Opus 4.6 | 💡💡💡💡 | ⚡⚡ | 💲💲💲💲 |

| Aktualizacje pól i kształtowanie zadań | Claude Opus 4.6 | 💡💡💡💡 | ⚡⚡ | 💲💲💲💲 |

| Odpowiedzi z rozumowaniem | Claude Opus 4.6 | 💡💡💡💡 | ⚡⚡ | 💲💲💲💲 |

| Ustrukturyzowane plany i specyfikacje | Claude Opus 4.6 | 💡💡💡💡 | ⚡⚡ | 💲💲💲💲 |

| Wstępne generowanie insightów | Claude Sonnet 4.5 | 💡💡💡 | ⚡⚡⚡ | 💲💲💲 |

| Końcowe kompaktowe kształtowanie | Claude Haiku 4.5 | 💡💡 | ⚡⚡⚡⚡ | 💲 |

Z mojego doświadczenia modele Anthropic są mniej więcej 2× droższe i 1,5× wolniejsze niż najbliższe alternatywy przy podobnej pracy. Mimo to wybieram je domyślnie, bo wyjście jest lepsze w aspektach, które liczą się przy planowaniu.

Różnica nie tkwi w kreatywności. Chodzi o zwięzłość, przestrzeganie instrukcji, stabilność rozumowania i czystsze ustrukturyzowane wyjście. Claude Opus 4.6 niezawodniej trzyma się szczegółowych ograniczeń, zadaje mniej zbędnych pytań wyjaśniających i potrzebuje mniej rund korygujących, gdy workflow oczekuje ustrukturyzowanych planów.

Kompromis jest realny, ale w workflow planowania wolę zapłacić więcej za czysty pierwszy przebieg, niż oszczędzać na wynikach, które potem wymagają poprawek.

Dlaczego Google trzyma wyszukiwanie i generowanie obrazów

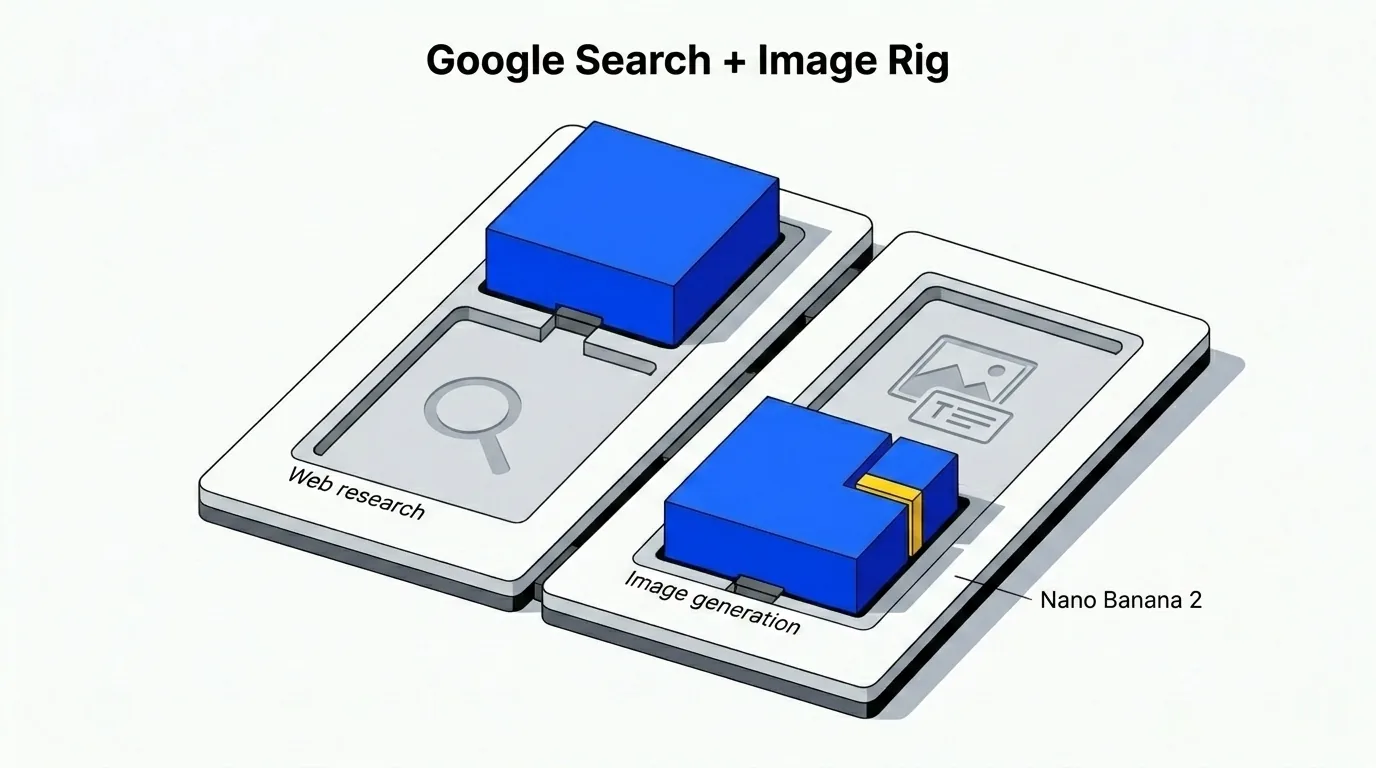

Gdy workflow potrzebuje świeżego kontekstu z sieci — analizy konkurencji, wyszukiwania dokumentacji technicznej i danych rynkowych — domyślny wybór przesuwa się na Google. Konkretnie Gemini 3.0 Pro do badań webowych.

To nie jest tylko odhaczycie pola w matrycy możliwości. Google spędził dekady na rozwiązywaniu problemów rankingu, trafności, świeżości i jakości źródeł na skalę internetu. To ma znaczenie, gdy wyniki zakotwiczone w sieci bezpośrednio zasilają dalsze planowanie. Jeśli krok wyszukiwania przynosi przestarzałe źródła lub halucynowane cytaty, plan zbudowany na ich podstawie dziedziczy te problemy.

Strona obrazowa podąża tą samą logiką. Obecne domyślne ustawienie to Gemini 3.1 Flash Image Preview — publicznie znany jako Nano Banana 2. Obsługuje obrazy z osadzonym tekstem bardziej konsekwentnie niż większość testowanych przeze mnie alternatyw: etykiety pozostają czytelne, układ trzyma się, a umieszczanie tekstu podąża za promptem zamiast dryfować.

Gdzie pasują OpenAI, xAI i Mistral

- OpenAI to oczywisty wszechstronny gracz: zdolny w tekście, rozumowaniu, ustrukturyzowanym wyjściu, wyszukiwaniu w sieci i generowaniu obrazów. Paradoksalnie ta szerokość jest po części powodem, dla którego nie jest domyślny dla rdzenia planowania. Gdy dostawca jest silny we wszystkim, często akceptujesz wystarczająco dobry wynik wszędzie, zamiast najlepszego tam, gdzie ma to największe znaczenie. Jako jedyny fallback jest wciąż trudny do pobicia i pozostaje najbardziej praktycznym wyborem dla zespołów, które wolą zarządzać jednym kluczem API niż mieszanym stackiem.

- xAI dojrzał szybciej, niż oczekiwałem. Grok obsługuje teraz pełne ustrukturyzowane wyjście z gwarantowaną zgodnością ze schematem, a integracja wyszukiwania w sieci jest solidna. Najbardziej naturalnie pasuje do pracy wrażliwej na szybkość — wczesnego generowania pomysłów, szybkich wyszukiwań i eksploracyjnych szkiców, gdzie czas realizacji jest ważniejszy niż dopracowanie.

- Mistral sprawdza się w lekkich, masowych zadaniach tekstowych, gdzie głównym ograniczeniem jest efektywność kosztowa. To także najnaturalniejszy wybór dla zespołów z wymaganiami dotyczącymi rezydencji danych w UE lub preferencją dla europejskiego stacku dostawców.

Kiedy wybrać inne modele

Ustawienia domyślne odzwierciedlają moją ocenę, nie powszechne prawo. Istnieją dobre powody, by je nadpisywać.

- Zespoły wrażliwe na koszty mogą uznać, że mnożnik Anthropic nie jest wart ich wolumenu.

- Zespoły wrażliwe na szybkość mogą preferować lżejsze modele do triażu lub generowania pomysłów.

- Niektóre organizacje chcą jednego dostawcy ze względu na spójność tonu, governance lub powody zakupowe.

Jeśli nie chcesz zarządzać wieloma kluczami API i dostawcami, używanie wyłącznie OpenAI do wszystkiego jest całkowicie rozsądną opcją. Ostatnio coraz bardziej podoba mi się też Google Gemini jako ogólny fallback — obie opcje warto przetestować na własnych zadaniach przed wyborem stacku.

Aktualne ustawienia, nie wieczna prawda

Mapowanie tutaj odzwierciedla to, jak dziś myślę o mocnych stronach dostawców. Anthropic trzyma rdzeń, bo jego modele dają obecnie najlepsze wyjście jakości planowania przy kompromisach, które jestem gotów zaakceptować. Google trzyma wyszukiwanie i pracę z obrazami, bo mocne strony infrastrukturalne Google naturalnie pasują do tych zadań.

Te ustawienia domyślne będą się rozwijać wraz ze zmianami modeli, cen i kompromisów. Stabilna powinna pozostać logika leżąca u ich podstaw: dobierać dostawcę do profilu zadania, a nie do jednego rankingu.

Jeśli konfigurujesz swój stack dostawców po raz pierwszy, zacznij od ustawień domyślnych, przepuść kilka prawdziwych zadań przez pełny workflow, a następnie nadpisuj tam, gdzie priorytety twojego zespołu wskazują inny kierunek. Celem nie jest teoretycznie najlepszy model — to stack, który sprawia, że twoje zadania w Jira są lepsze, szybsze i z mniejszymi tarciami.