Just 2.0: Analysen, Websuche, Bilder und gemeinsamer Kontext

Just: KI-Assistent für Jira hat einen deutlichen Sprung gemacht. Analysen klären jetzt zuerst, planen danach, holen frischen Web-Kontext, erzeugen Bilder, lernen aus Feedback und arbeiten mit wiederverwendbarem Kontext auf Projekt- oder Organisationsebene.

Das ist bisher das größte Update für Just.

Mit diesem Release macht Just: KI-Assistent für Jira einen echten Sprung nach vorn. Analysen stellen jetzt erst Rückfragen, bauen danach einen Plan, können frischen Web-Kontext einbeziehen, im selben Lauf Bilder erzeugen und sich über Projekt-Feedback mit der Zeit verbessern.

Der zweite große Wandel betrifft den Kontext. Teams können wiederverwendbaren Kontext jetzt entweder in einem einzelnen Projekt halten oder für die ganze Organisation verfügbar machen – je nachdem, wie weit dieses Wissen reichen soll.

Auch der Preis hat sich geändert, darauf komme ich weiter unten zurück. Die eigentliche Schlagzeile ist aber der Produktsprung selbst. Im Kern ist das hier Just 2.0.

Was sich praktisch geändert hat:

- Analysen klären jetzt zuerst, bevor sie planen.

- Ein Lauf kann Webrecherche und Bilderzeugung kombinieren.

- Feedback prägt künftige Ergebnisse auf Projektebene.

- Kontext kann lokal im Projekt bleiben oder organisationsweit geteilt werden.

Neuer Name, neues Zeichen

Nicht nur das Produkt hat sich verändert. Auch Name und visuelle Identität haben sich geändert.

Just: AI Starter Kit for Jira war ein ehrlicher Name in der frühen Phase, als das Produkt noch eher ein kompaktes Bündel von KI-Abläufen war. Just: KI-Assistent für Jira beschreibt inzwischen viel genauer, was daraus geworden ist: Das Produkt erzeugt nicht nur Text, sondern begleitet ein Jira-Ticket durch Fragen, Analysen, Recherche, wiederverwendbare Szenarien und eine kontrollierte Ausführung.

Früheres Zeichen: einfacher, schärfer und näher an der Starter-Kit-Phase.

Neues Zeichen: weicher, vielschichtiger und näher an dem, was das Produkt heute ist.

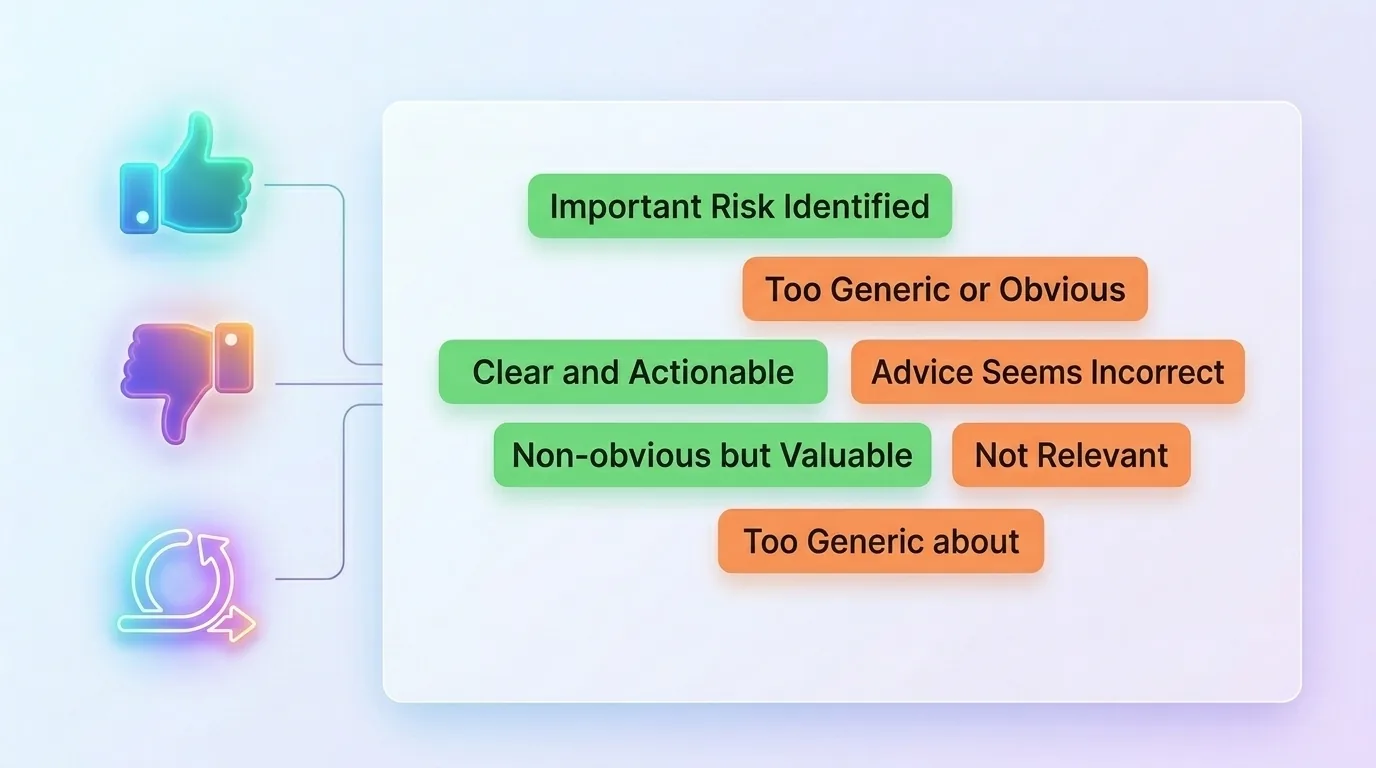

Erst Fragen, dann Plan

Die wichtigste Änderung betrifft die Art, wie Just jetzt Ergebnisse aufbaut.

Frühere Versionen haben direkt aus dem Ticket ein Ergebnis erzeugt. Das Modell hat das Issue gelesen und etwas Strukturiertes und Plausibles ausgegeben. Das funktioniert, wenn das Ticket bereits klar formuliert ist.

Nur sind die meisten Tickets eben nicht klar. Sie werden schnell geschrieben, stecken voller unausgesprochener Annahmen und lassen gerade die Entscheidungen offen, die für die Umsetzung am meisten zählen.

Die aktuelle Version stellt zuerst Rückfragen. Man öffnet ein Issue, startet eine Analyse, und Just legt erst einmal konkrete Fragen offen, bevor irgendetwas gebaut wird. Erst nach den Antworten wird der Plan erstellt – nicht aus dem, was das Modell vielleicht gemeint haben könnte, sondern aus explizit festgehaltenen Entscheidungen.

Das klingt nach einer kleinen Änderung. In der Praxis verschiebt es das Ergebnis von einer plausiblen Antwort auf einen mehrdeutigen Input zu einem strukturierten Plan auf Basis klarer Entscheidungen. Und der Unterschied fällt sofort auf, sobald man das Resultat jemand anderem im Team erklären muss.

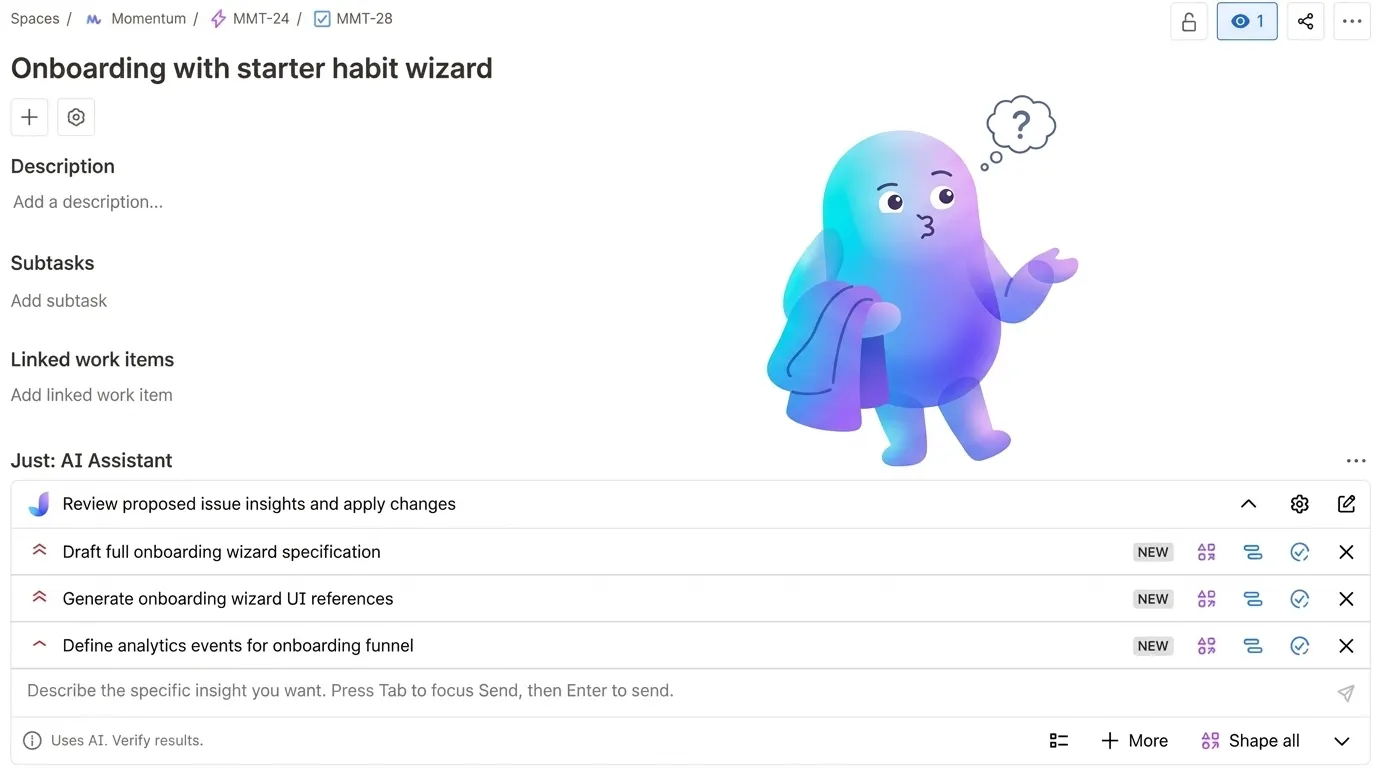

Webrecherche und Bilder in einem Lauf

Just unterstützt jetzt Websuche und Bilderzeugung innerhalb eines einzigen Analyse-Laufs.

Wenn ein Ticket etwas betrifft, das sich laufend verändert – eine API, ein Wettbewerbsfeature, eine Compliance-Anforderung –, holt der Websuch-Schritt aktuelle Informationen, bevor der Plan entsteht. Das ist wichtig, weil jedes KI-Modell einen Wissensschnitt in seinen Trainingsdaten hat. Ein Modell, das nur aus diesem Training arbeitet, weiß nicht, was sich in den letzten Monaten geändert hat. Ein Live-Suchschritt weiß es.

Die Bilderzeugung läuft über Geminis Bildmodell, das in diesem Preisbereich visuelle Konsistenz und Text im Bild spürbar besser hinbekommt als die meisten Alternativen. Beide Schritte sind pro Analyse optional: Man aktiviert sie dann, wenn das Ticket sie braucht – nicht standardmäßig.

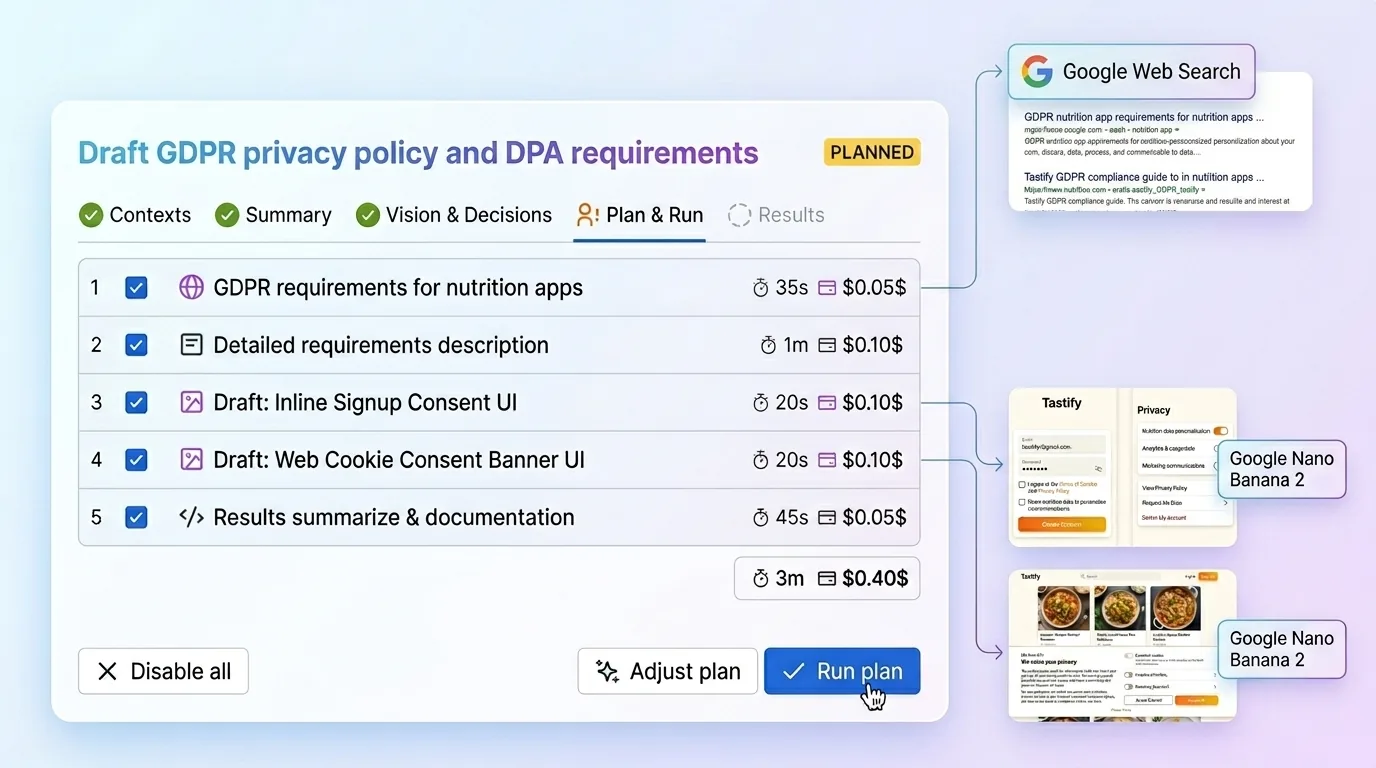

Feedback, das spätere Ergebnisse verbessert

Jede Analyse hat jetzt eine Feedback-Schicht.

Man kann ein Ergebnis als nützlich oder nicht nützlich markieren und auf Wunsch kurz begründen, warum. Diese Beispiele sammeln sich pro Projekt und werden in künftigen Läufen als positives und negatives Signal wiederverwendet. Gute Ergebnisse ziehen spätere Ausgaben in Richtung dessen, was das Team wirklich hilfreich fand. Schlechte Ergebnisse helfen dem Modell, genau diese Art von Fehlschuss zu vermeiden.

Das ist kein globales Modelltraining. Es ist eine projektbezogene Feinjustierung. Mit der Zeit passt sich Just dadurch immer besser an die Art von Ergebnis an, die das Team tatsächlich verwendet – statt generische Antworten zu liefern, die dem Modell nur halbwegs vernünftig erschienen.

Kontext auf Projekt- oder Organisationsebene

Auch der Kontext ist deutlich flexibler geworden.

Manche Teams möchten, dass alle Projekte denselben Produktkontext, dieselbe Zielgruppe und dieselben Grundkonventionen erben. Andere brauchen bewusst getrennte Kontexte, weil Produkte, Nutzer oder Abläufe wirklich unterschiedlich sind. Just unterstützt inzwischen beides.

Kontext kann lokal in einem Projekt bleiben oder organisationsweit wiederverwendbar sein. Das klingt zunächst nach einem Konfigurationsdetail, verändert aber stark, wie praktikabel sich das Produkt im Alltag anfühlt. Gemeinsamer Kontext reduziert Einrichtungsarbeit. Projektgebundener Kontext verhindert, dass die Annahmen eines Teams in die Arbeit eines anderen hineinlaufen.

In der Praxis passt sich das System dadurch viel besser an reale Organisationen an, statt alle in ein einziges Kontextmodell zu zwingen.

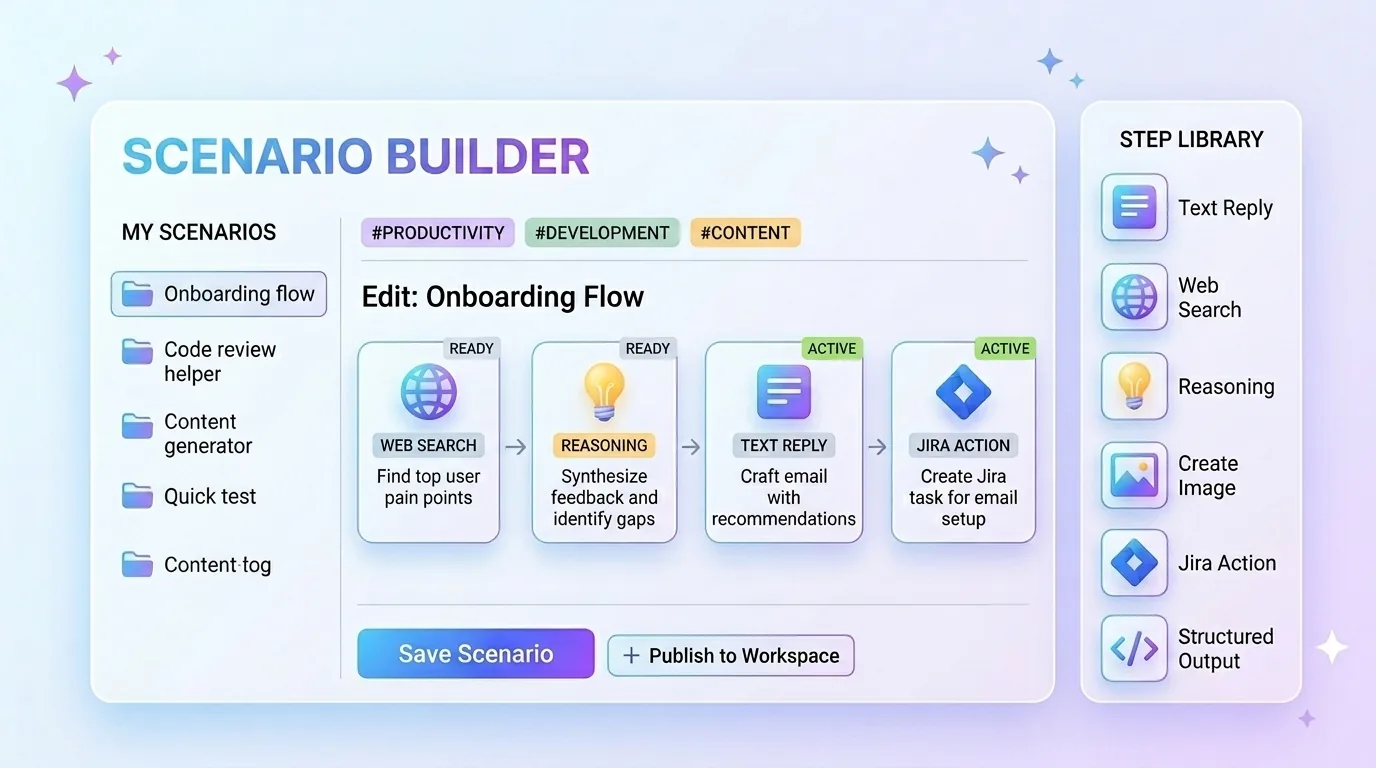

Eigene Szenarien bauen

Mit dem Szenario-Editor lassen sich eigene wiederverwendbare Abläufe erstellen, anpassen und speichern.

Ein Szenario ist eine Folge konfigurierter Schritte, jeweils mit eigenem Modell, eigenen Anweisungen und eigenem Ausgabeformat. Man kann eines für Akzeptanzkriterien bauen, ein anderes für technisches Scoping und ein drittes für Wettbewerbsrecherche bei neuen Feature-Tickets. Danach steht dieses Szenario direkt in Jira bereit und lässt sich mit einem Klick für jedes Issue starten.

Das war die häufigste Bitte früher Nutzer. Der eingebaute Analyse-Ablauf ist bereits für sich nützlich. Richtig alltagstauglich wird KI-Unterstützung aber erst dann, wenn man die konkrete Arbeitsweise des eigenen Teams – bevorzugte Struktur, Pflichtfelder, gewünschte Analysetiefe – in etwas Wiederverwendbares übersetzen kann.

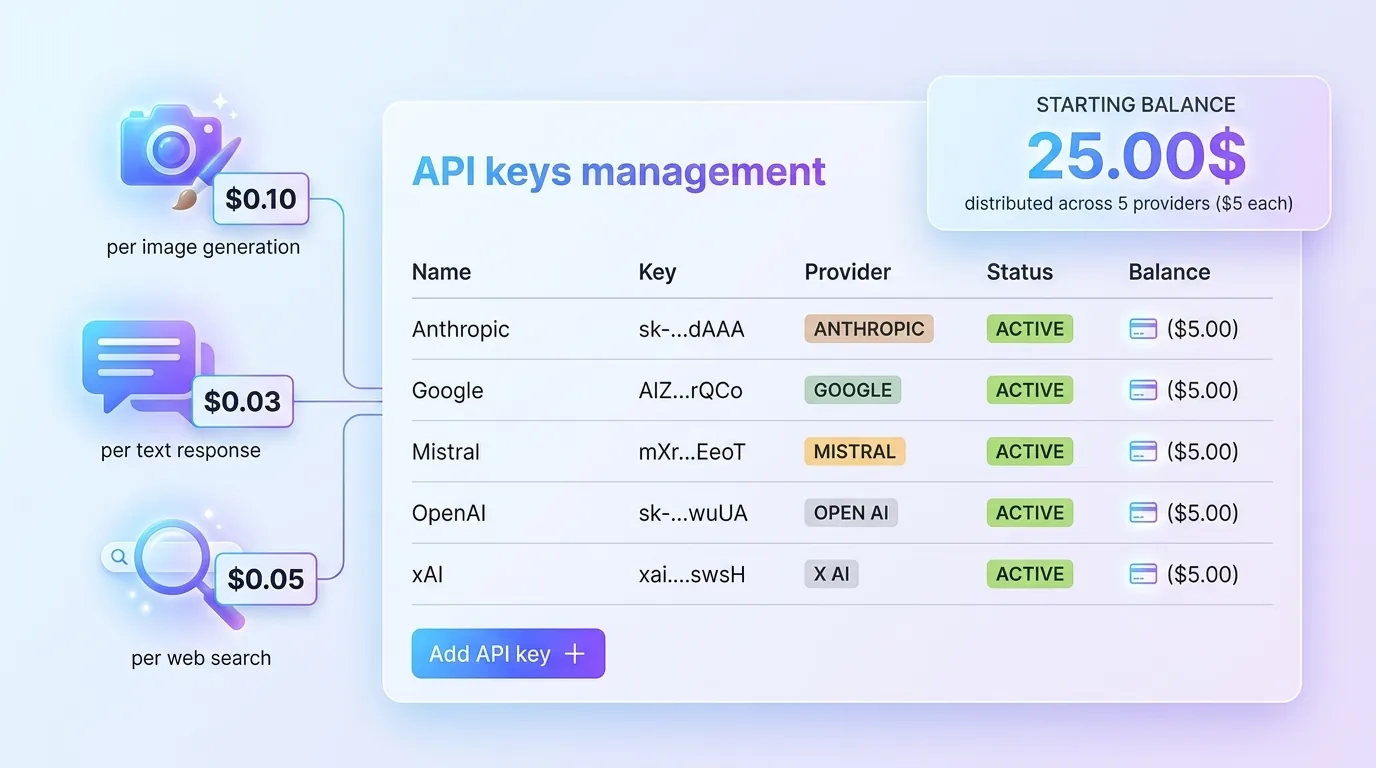

Transparente Kosten: Credits, Schlüssel und Kontrolle

Just arbeitet mit fünf Anbietern: Anthropic, OpenAI, Google, xAI und Mistral. Neue Installationen starten mit 25 Dollar Onboarding-Guthaben, verteilt über mehrere Anbieter, damit man echte Abläufe testen kann, bevor eigene API-Schlüssel eingerichtet werden.

Sobald dieses Guthaben verbraucht ist, ist das Modell ziemlich klar:

- Das Team verbindet die eigenen Anbieter-Schlüssel.

- Die Kosten bleiben auf Schrittniveau sichtbar – was jeder Anbieter, jeder Schritt und jeder Analyse-Lauf tatsächlich kostet.

- Das Guthaben ist als Einstieg gedacht, nicht als dauerhaftes Geschäftsmodell. Im Regelbetrieb läuft Just mit eigenen Schlüsseln und voller Kostentransparenz.

Wenn du sehen willst, wie sich diese Kosten auf Teamebene zusammensetzen, habe ich das in Das KI-Budget, über das kaum jemand spricht separat aufgeschrieben.

Das Routing ist bewusst flexibel. Man kann einen Anbieter für alles nutzen oder verschiedene Modelle verschiedenen Schritttypen zuweisen. Die Standardeinstellungen spiegeln wider, womit ich aktuell die besten Ergebnisse für die jeweilige Aufgabe bekomme – Anthropic für den Planungskern, Google für Recherche und Bilder –, aber alles lässt sich überschreiben.

Zur Preisänderung

Just ist von 1 Dollar auf 5 Dollar pro Nutzer und Monat gestiegen.

Der Preis von 1 Dollar war zu dem Zeitpunkt ehrlich. Just war damals experimentell. Nichts von dem, was oben beschrieben ist, existierte bereits im Produkt. Ein System, das Rückfragen stellt, live recherchiert, Bilder erzeugt, Feedback wiederverwendet, eigene Szenarien unterstützt und Kontext auf Projekt- oder Organisationsebene steuern kann, war damals Roadmap – nicht Realität.

Dieses Produkt gibt es jetzt. Die 5 Dollar pro Nutzer spiegeln wider, was heute tatsächlich enthalten ist. Der Preis liegt weiterhin unter vielen vergleichbaren KI-Tools für Jira, und er enthält noch immer keine KI-Nutzungskosten – diese bleiben transparent und laufen direkt über die eigenen API-Schlüssel.

Für bestehende Abonnenten gilt: Nach Atlassians Preisrichtlinie vergehen sechs Monate, bevor eine Preisänderung in der Rechnung auftaucht. Es ändert sich also nicht sofort etwas. Der 1-Dollar-Tarif bleibt bis Oktober 2026 bestehen.

Wenn du über die Änderung sprechen, verstehen willst, was sie für dein Team bedeutet, oder einfach Feedback zum Produkt geben möchtest, melde dich direkt. Ich lese jede Nachricht.